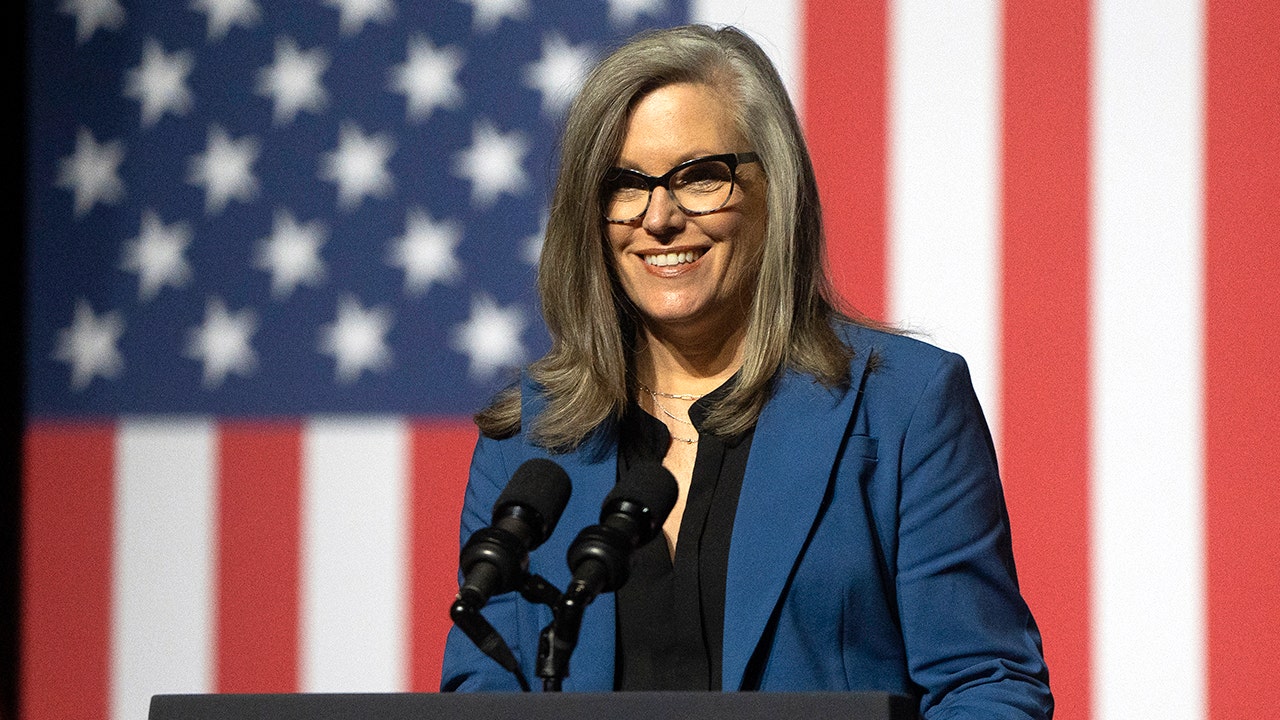

Dr. Henrietta Hughes OBE, Britse commissaris voor patiëntveiligheid (Credit: foto door Londense fotograaf)

Zorgen over veiligheid, toezicht en aansprakelijkheid leiden tot zorgen over het gebruik van AI in de gezondheidszorg, zo blijkt uit bevindingen van de Medicines and Healthcare products Regulatory Agency (MHRA).

De oproep tot bewijsmateriaal, gelanceerd in december 2025, benadrukt het ongemak over het monitoren van AI-instrumenten en wie verantwoordelijk is als er iets misgaat, volgens een blogpost van professor Henrietta Hughes, de commissaris voor patiëntveiligheid.

Deze bevindingen zullen input leveren voor de Nationale Commissie voor de Regulering van AI in de Gezondheidszorg, die is opgericht om een snellere adoptie van AI-instrumenten zoals ambient voice-technologie te ondersteunen.

Er werden ruim 770 reacties ingediend door artsen, de industrie, patiënten en het publiek voordat de consultatie in februari 2026 werd afgesloten.

Hughes, vice-voorzitter van de commissie, zei dat er “sterke steun is voor de hervorming van de huidige regelgevingsaanpak”, waarbij er bezorgdheid bestaat over de manier waarop AI-medische apparaten zullen worden gemonitord zodra ze worden ingezet en wie verantwoordelijk zal worden gehouden zodra AI meer betrokken raakt bij de klinische besluitvorming.

“Het aanpakken van dit probleem is van cruciaal belang voor de bescherming van patiënten, het ondersteunen van artsen en het opbouwen van vertrouwen, en vereist samenwerking binnen het hele systeem”, zei hij.

Hughes voegde eraan toe dat “de gemeenschap betekenisvolle veranderingen wil, maar geen volledige herziening” van de bestaande regelgeving.

Naast de oproep om bewijsmateriaal zei Hughes dat er een breder betrokkenheidsprogramma gaande was om ervoor te zorgen dat een breed scala aan stemmen het werk van de commissie beïnvloedde.

De MHRA heeft samengewerkt met patiënten en gemeenschappen, inclusief degenen die vaak over het hoofd worden gezien, zoals mensen met leerproblemen, verzorgers en jongeren, in samenwerking met National Voices.

Ze ondersteunen ook openbare discussiesessies verzorgd door The Health Foundation met Ipsos MORI, en overleg met patiëntengemeenschappen en het publiek.

“Deze discussie laat zien dat het publiek zich meer op zijn gemak voelt als AI artsen ondersteunt, bijvoorbeeld door de administratieve lasten te verminderen, in plaats van zelfstandig risicovolle beslissingen te nemen.

“Er ligt een sterke nadruk op menselijk toezicht, transparantie en bewijs dat de technologie voor iedereen veilig werkt.

“Bij alle opdrachten kwam een consistent beeld naar voren dat vertrouwen van cruciaal belang is bij het bepalen of de voordelen van AI in de gezondheidszorg kunnen worden gerealiseerd”, aldus Hughes.

Het werk van de commissie wordt ondersteund door vier werkgroepen die deskundigen samenbrengen op het gebied van gezondheidszorgsystemen, technologie, gedecentraliseerde staten en bestuur.

“Als voorzitter van de Health Systems Working Group wil ik ervoor zorgen dat AI wordt gebruikt op een manier die het perspectief van de patiënt omvat.

“Dit betekent dat we een patiëntgerichte kijk moeten hebben op hoe technologie wordt ontworpen, geïmplementeerd en gemonitord in de dagelijkse gezondheidszorg”, aldus Hughes.

De aanbevelingen van de commissie zullen naar verwachting in de zomer van 2026 worden gepubliceerd.

Hughes organiseerde op 20 mei 2026 een open publiek webinar over de commissie, met Lawrence Tallon, algemeen directeur van de MHRA, en professor Alastair Denniston, voorzitter van de commissie.

Hier kunt u zich aanmelden en vooraf uw vragen stellen.