Je hebt waarschijnlijk wel eens gehoord van vibratiecodering en misschien heb je zelf een paar experimenten gedaan, vroeg je Claude of iemand anders AI tools voor het maken van eenvoudige websites of interactieve games. Mede-oprichter van OpenAI Andrej Karpathy bedacht de uitdrukking met a tweeten in februari 2025. In de eenvoudigste bewoordingen houdt vibratiecodering het vertellen van a in AI programmeer wat je wilt bereiken en laat het door AI coderen. Het maakt gebruik van natuurlijke taal van gebruikers om software te genereren.

Vibe-codering is een werkelijk revolutionaire democratisering van softwareontwikkeling. Hierdoor kan iedereen met een computer en een beetje fantasie software produceren die, althans op het eerste gezicht, lijkt te doen wat je vraagt.

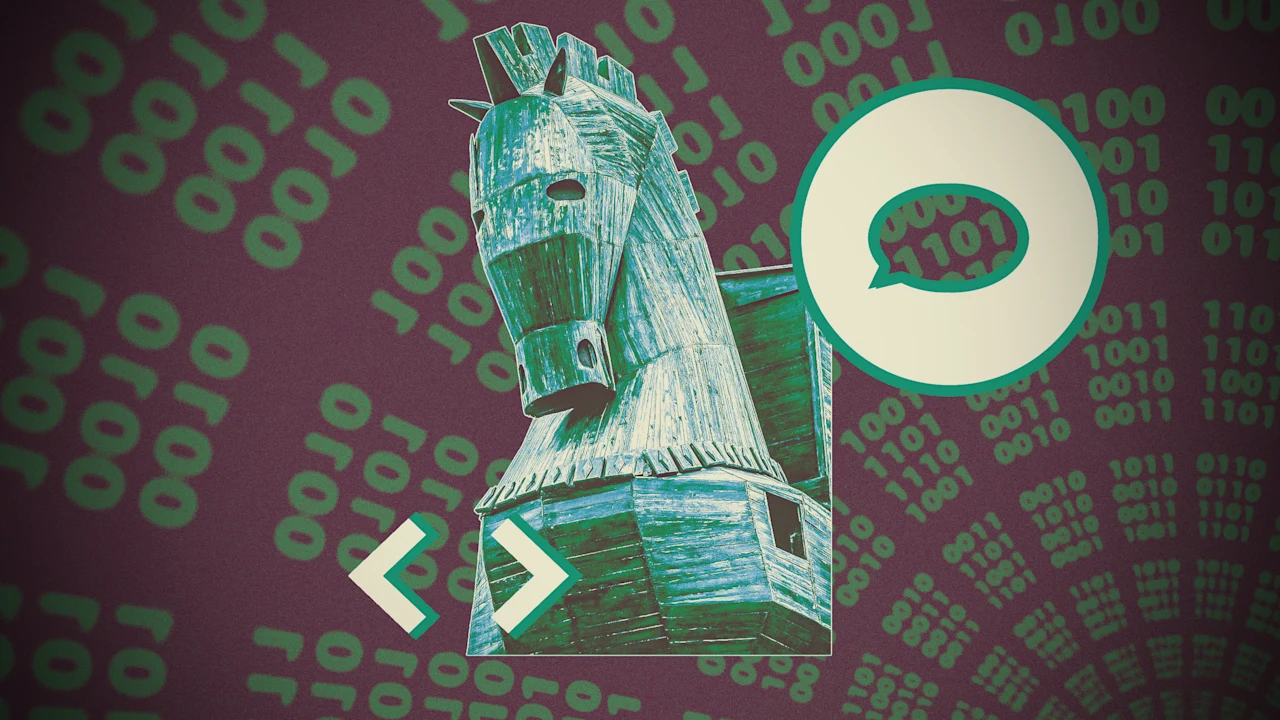

En daarin schuilt het probleem. Iedereen in een bedrijf kan mogelijk software in de cyberbeveiligingsperimeter van een bedrijf injecteren zonder gehinderd te worden door enige kennis van hoe de software werkt en waarvoor deze is ontworpen om buiten uw intelligente commando om te doen.

Als de code die door een medewerker is gemaakt algoritmisch is afgeleid van een gecontroleerde, openbaar beschikbare bron, heeft u geluk. Maar de fundamentele gevaren van door AI gegenereerde code in feite weet je niet waar het vandaan komt, wat de bron is, of hoe het is verzameld. Is de bron een promovendus aan een topuniversiteit, een hacker die in een kelder woont, een door de staat gesponsorde cyberterrorist? Al het bovenstaande?

Het AI-programma dat u gebruikt, weet het niet en het kan het ook niets schelen. Het vervult getrouw zijn missie van ultrasnelle, onbewuste patroonvergelijking.

De deur openen voor een ramp

Dat geweldige programma dat je zojuist hebt gemaakt zonder ooit een regel code te hebben leren schrijven, kan spyware, virussen of malware van wereldklasse bevatten die bedrijfsgegevens of zogenaamde S-gegevens kunnen extraheren (d.w.z. exfiltreren).QL-injectie die grote schade kunnen aanrichten aan uw database. Het mooie vanuit het perspectief van slechte acteurs is dat ze geen achterdeur nodig hebben: de domme medewerker die de mysteriecode importeert, laat de voordeur gewoon wijd open.

Maar wacht, er is meer.

De trillingscode die uw werknemer op magische wijze genereert met zijn nieuwe AI-metgezel kan ook in strijd zijn met auteursrecht- of patentwetten. Hoe schat u de kans in dat de gemiddelde niet-technische medewerker hiermee te maken krijgt? Deze waarschijnlijkheid is hoogstwaarschijnlijk een getal dat dicht bij nul ligt. Door AI gegenereerde aansprakelijkheid voor intellectueel eigendom kan het procesprofiel van uw bedrijf radicaal veranderen.

Wanneer u codeert via een LLM, zoals elke door mensen ontwikkelde code, zal deze bugs bevatten. Maar in tegenstelling tot code die door mensen is gemaakt, begrijpt niemand van het personeel echt hoe deze wordt gemaakt. Dit omvat de vraag of de structuur deugdelijk is of niet, hoe coherent deze is en waar de kwetsbaarheden liggen. Het aanpakken van dit probleem lijkt op dit moment geen topprioriteit te hebben verdomde torpedo’s, vooruit op volle snelheid de mentaliteit van het door AI geobsedeerde moment van vandaag.

Wat kunnen leiders van organisaties doen om deze risico’s te beheersen en potentiële rampen te beperken? Het begrijpen van de gevaren is de eerste stap. Overweeg de volgende stappen te ondernemen.

Dit is een kwestie op C-niveau, dus behandel het als zodanig

AI-beveiliging is niet in de eerste plaats een IT-probleem: het is een strategische kwestie voor het senior management in de hele onderneming. Overweeg interacties met AI op het gebied van financiën, HR, recht, verkoop en marketinghet ontwerp, de engineering en de technische aspecten van AI-interacties zijn slechts het startpunt. AI-beveiliging moet worden behandeld als een bedrijfskwestie. Dit kan niet zomaar aan IT worden gedelegeerd volgens de standaard cyberbeveiligingsprocedures.

Bouw beveiliging in uw processen

Wacht niet met reageren na het incident. Als het om AI-risico’s gaat, is de oude aanpak van het creëren van beleid en het laten onderkennen van dat beleid door werknemers niet voldoende. Risicomonitoring en -sanering zou deel moeten uitmaken van het technische proces zelf, en niet van een apart statisch beleid dat je geacht wordt te volgen terwijl je ergens digitaal stof verzamelt in een of andere virtuele map. Er zijn nieuwe softwareprogramma’s die zijn ontworpen om dit soort risico’s te signaleren, beoordelen, meten en aanpakken voordat ze uitmonden in een crisis. Overweeg om het zo snel mogelijk in te voeren om ervoor te zorgen dat uw beveiliging gelijke tred houdt met de AI-implementatie.

Eis verantwoordelijkheid van dienstverleners

Vraag uw leveranciers om duidelijk uit te leggen hoe AI in hun applicaties wordt geïntegreerd, wat de risico’s zijn, hoe deze risico’s in realtime (seconden of minuten, niet kwartalen) kunnen worden beoordeeld en aangepakt wanneer ze zich binnen de applicatie zelf voordoen. Dit wordt snel een nieuwe vereiste die veel verder gaat dan standaard beveiligingsvragenlijsten.

Raadpleeg een deskundige

Er is een nieuwe industrie in opkomst die tot doel heeft de kloof te dichten tussen het explosieve gebruik van AI in organisaties op alle niveaus en het gebrek aan responsprotocollen voor de grotendeels ongeïdentificeerde risico’s die zich in razend tempo voordoen. Het is een goed idee om advies in te winnen bij deskundigen.

Het vermogen van AI om niet-technische medewerkers in staat te stellen te coderen is werkelijk revolutionair. Maar zoals de geschiedenis leert, kunnen revoluties op verschillende manieren plaatsvinden. Het is belangrijk om de nieuwe risico’s die inherent zijn aan deze nieuwe mogelijkheden te onderkennen en aan te pakken. Trillingen kunnen je slechts tot nu toe brengen.