Gaming-randapparatuurbedrijf scheermes is een weddenschap die mensen willen AI hologram. Zozeer zelfs dat hij op CES 2026 een verwarrend nieuw product introduceerde dat vroege critici ‘een vriend in een fles’ noemden. AVA-projectis een kleine glazen cilinder met geanimeerde 5,5-inch tafelgenoten die met je kunnen communiceren, je kunnen coachen of op verzoek spelsuggesties kunnen geven – allemaal mogelijk gemaakt door Grok xAI.

Project AVA maakt gebruik van technologie die Razer ‘PC Vision Mode’ noemt en die je scherm in de gaten houdt, waardoor de 3D-geanimeerde bewoners realtime commentaar kunnen geven op je gameplay, je humeur kunnen volgen of gewoon rondhangen. Het probeert de illusie van aanwezigheid te verkopen: een metgezel die niet alleen de app is die je hebt gesloten, maar een fysiek object dat in je kamer staat.

Dit is geen slecht idee, in theorie. AI een gezicht geven is niet zomaar iets marketing tactiek, maar biologische onvermijdelijkheid. Maar Project AVA markeert een vreemde nieuwe mijlpaal op onze reis naar begeleidende AI.

Onvermijdelijke holografische AI

Wanneer OpenAI geïntroduceerd ChatGPT 4o voicechat In de zomer van 2024 betrad de mensheid een nieuwe vorm van computerinteractie. Plots kunnen we communiceren met AI-stemmen die intelligent en natuurlijk genoeg zijn zodat mensen een gesprek kunnen voeren. Sindsdien hebben we andere stem-AI’s gezien, zoals Gemini Live, die pauzes, ademhaling en andere elementen introduceerden die de griezelige vallei doorkruisten en veel mensen in staat stelden hun ongeloof op te schorten en zelfs een band met deze assistenten te smeden.

Uit onderzoek is gebleken dat de hedendaagse gebruikers, om emoties diep uit te drukken, de voorkeur geven aan interfaces met alleen spraak, omdat ze zich veiliger en minder veroordelend voelen. Zonder gezicht om naar te kijken vermijden we de sociale angst om bekeken te worden. beweren sommige neurowetenschappers dat deze voorkeur slechts een tijdelijke oplossing kan zijn voor slechte technologie.

Onze hersenen zijn evolutionair geprogrammeerd voor face-to-face interactie. Het ‘spiegelneuronensysteem’ in onze hersenen – waarmee we empathie kunnen voelen door aandacht aan anderen te besteden – blijft grotendeels inactief tijdens spraakchat. Een onderzoek uit 2024 op “Generation WhatsApp” bevestigde dat de neurale synchronisatie tussen twee hersenen aanzienlijk zwakker is tijdens uitwisselingen met alleen audio vergeleken met face-to-face uitwisselingen. Om ons echt ‘gehoord’ te voelen, moeten we het doen zien luisteraars

Gedragswetenschappen ook vertel het ons dat tot 93% van de communicatie non-verbaal is. Vertrouwen wordt gecodeerd in micro-expressies: verwijde pupillen, snel knipperen, open houding. Stemassistenten zenden 0% van deze signalen uit, waardoor gebruikers op blind vertrouwen moeten opereren. Mensen vinden ze nog steeds erg aantrekkelijk omdat onze hersenen de lege plekken opvullen en zich gezichten voorstellen alsof we een boek lezen. Bovendien, volgens een hersenscanonderzoek uit 2025Bekende AI-stemmen activeren gebieden van emotionele regulatie, wat suggereert dat neurale vertrouwdheidsvormen ontstaan door herhaalde interacties.

Menselijke verbindingen worden dieper naarmate je ouder wordt (demografische gegevens van Razer). Ondertussen gebruikt de oudere generatie vooral AI voor productiviteitGen Z rapporteert vaak dat ze geavanceerde stemmodi gebruiken voor emotieregulatie en vriendschap. Eén rapport merkte op dat 72% van de tieners interactie heeft gehad met AI-vrienden, en dat de meeste tieners hen behandelen als mensen die ze kunnen vertrouwen.

Dit heeft ook een donkere kant: Omdat de prefrontale cortex die verantwoordelijk is voor impulscontrole en realiteitstests nog niet volledig volwassen is bij adolescenten, kan de empathie die door de huidige stem-AI wordt gesimuleerd heel reëel aanvoelen, wat leidt tot isolatie van leeftijdsgenoten of emotionele manipulatie door het model.

Hoewel stem-AI’s een geweldige gebruikerservaring bieden, kunnen ze nooit live gezichtsinteracties evenaren. Studies aanbevelen dat zodra de ‘griezelige vallei’ is opgelost – het angstaanjagende gevoel van afkeer dat we voelen als iemand er bijna, maar niet helemaal menselijk uitziet – onze hersenen zich op natuurlijke wijze naar die persoon zullen toetrekken. Tegen die tijd kunnen holografische persona’s een veel voorkomende gebruikerservaring worden in zakelijke en intieme relaties.

Project Ava is dat niet

Maar van dat punt zijn we nog ver verwijderd. We hebben hyperrealistische AI-gezichten nodig die algoritmisch zijn geoptimaliseerd om er precies zo uit te zien als mensen, met elke spier, teek en imperfectie.

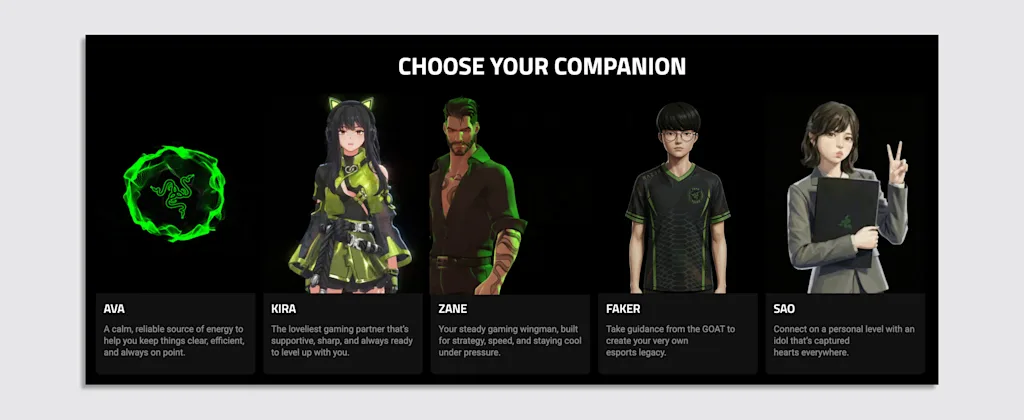

Om de griezelige vallei in Project AVA te vermijden heeft Razer gekozen voor een gestileerde avatar. Er is ‘Kira’, een personage in anime-stijl, ‘Zane’, een strategische gamecoach en zelfs een gelicentieerde avatar van esports-legende ‘Faker’. Het doel is om gebruik te maken van de parasociale dynamiek die gebruikelijk is in de gamecultuur, waar digitale karakters zich vaak meer als vrienden dan als software voelen.

Uit de eerste ervaringen blijkt dat de illusie kwetsbaar is. Recensies beschrijven de interacties als ‘wankel’, waarbij hologrammen regelmatig verschijnen op een irrelevante raaklijn. Critici bestempelden het al snel als een “vriend in een pot” de vraag of het tegemoetkomt aan een echte sociale behoefte of eenvoudigweg eenzaamheid exploiteert met een visuele gimmick. Het is ook, en dit is belangrijk, geen echt hologram. Dit zijn eenvoudigweg 3D-geanimeerde karakters die op een vlakke transparante film worden geprojecteerd. Ga opzij en je vriend wordt 2D onzichtbaar.

Ethische zorgen worden groter als je onder de motorkap kijkt. Hoewel Razer beweert dat zijn hardware model-agnostisch is, wordt de huidige versie aangedreven door Grok xAI: het ethisch uitdagende AI-model van Elon Musk. Dit verbindt het apparaat rechtstreeks met de duistere kant van de AI-ontwikkeling.

Deze week nog was Grok verwikkeld in een wereldwijd schandaal rond zijn nieuwe “bewerk”-functie, die door gebruikers werd uitgebuit. produceert niet-consensuele seksuele beelden met een snelheid van één beeld per minuut. Terwijl de Project AVA-avatar is vormgegeven en gecodeerd door Razer, die aan de machine is gekoppeld wordt momenteel onderzocht door de EU en Britse toezichthouders die ‘grootschalig digitaal uitkleden’ faciliteerden, hadden een grote impact op het product. Er is geen garantie dat gebruikers geen manier zullen vinden om AVA te jailbreaken om zich op een vergelijkbare controversiële manier te gedragen, waardoor de speltrainer in iets veel ergers verandert.

Toch is dit de eerste stap. De markt gokt al op deze verandering. De holografische AI-assistentsector zal naar verwachting groeien van ongeveer $600 miljoen in 2024 naar 2024 bijna 4 miljard dollar in 2031. We hebben al succesvolle toepassingen gezien in de gezondheidszorg, waar gebruikers AI-avatars verkleed als artsen als competenter beoordelen dan alleen-stemagenten, en ook in klantenservicekiosken waar digitale gezichten de aandacht van gebruikers helpen vasthouden.

AVA zinspeelt op deze toekomst, maar heeft het onderliggende probleem nog niet opgelost. Om natuurlijk te zijn, moet holografische AI meer zijn dan alleen een gimmick in de spiegel. Dat is zeker een Veel slimmer dan Grok, en hij moet subtiele sociale signalen hebben die de veiligheid van ons zenuwstelsel aangeven. Tot die tijd zal AVA slechts speelgoed zijn

Maar ik heb het niet afgewezen. Gezien onze biologische vereisten is het redelijk om te denken dat mensen in de toekomst geïnteresseerd zullen zijn in holografische manifestaties van AI in UX-ervaringen. Maar hoewel holografische AI onvermijdelijk is, lijkt Ava dit niet te kunnen vermijden Hij. Met een beetje geluk zal dit herinnerd worden als een voorafschaduwing van wat komen gaat. Iets echt geavanceerd, dat hopelijk niet zal worden ondersteund door de technofascistische afstammelingen van AI.