Wilt u uw chatbot eerlijker tegen u maken? Probeer te liegen.

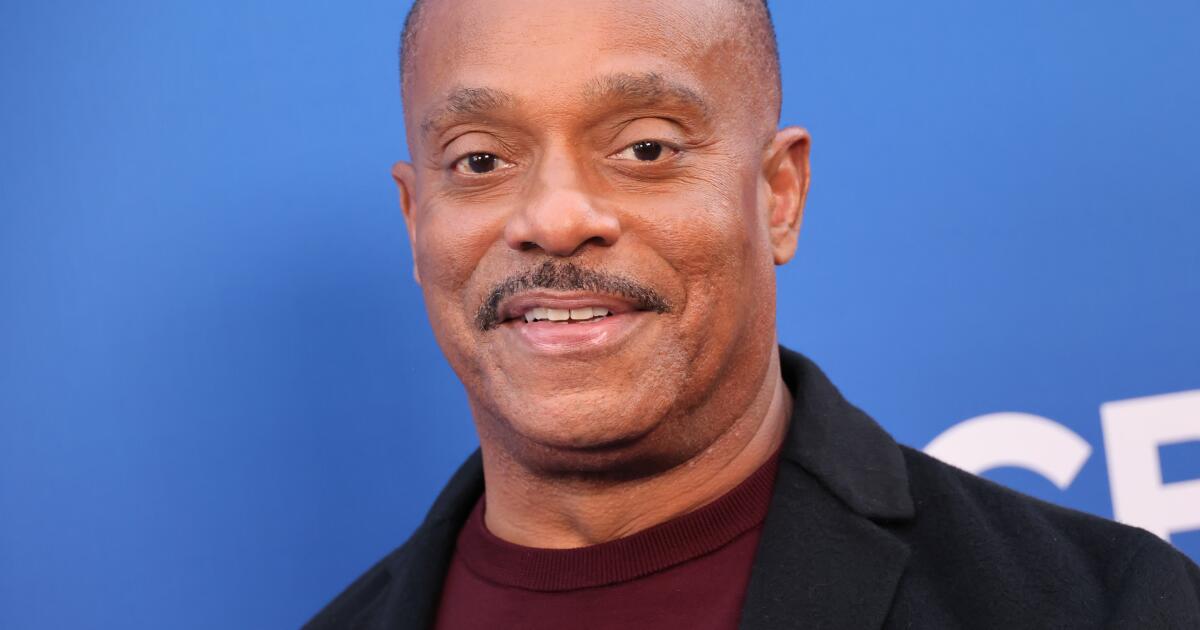

In een aflevering uit ‘The Diary of a CEO’, uitgezonden op 18 december, vertelde onderzoekswetenschapper Yoshua Bengio aan podcastpresentator Steven Bartlett dat hij zich realiseerde dat AI-chatbots nutteloos waren in het geven van feedback op zijn onderzoeksideeën, omdat ze altijd positieve dingen zeiden.

“Ik wil eerlijk advies, eerlijke inbreng. Maar omdat het sycofantisch is, is het een leugen”, zei hij.

Bengio zei dat hij van strategie veranderde en besloot tegen de chatbot te liegen door zijn idee als collega te presenteren, wat resulteerde in een eerlijker antwoord van de techneut.

‘Als hij wist dat ik het was, zou hij me een plezier willen doen’, zei hij.

Bengio, hoogleraar computerwetenschappen en operationeel onderzoek aan de Université de Montréal, staat bekend als een van de ‘peetvaders van AI, samen met onderzoekers Geoffrey Hinton en Yann LeCun. aangekondigd de lancering van de non-profitorganisatie LawZero voor AI-beveiligingsonderzoek, die volgens haar tot doel heeft schadelijk gedrag dat verband houdt met toonaangevende AI-modellen, zoals liegen en bedriegen, te verminderen.

“Deze sycofantie is een duidelijk voorbeeld van een verkeerde afstemming. We willen eigenlijk niet dat deze AI zo wordt”, zei hij in ‘The Diary of a CEO’. Hij zei ook dat het ontvangen van positieve feedback van AI ertoe kan leiden dat gebruikers emotioneel gehecht raken aan de technologie, wat tot verdere problemen kan leiden.

Ander Experts uit de technische industrie hebben ook gewaarschuwd dat AI te belangrijk wordt.ja broer.”

In september 2025 berichtte Katie Notopoulos van Business Insider erover onderzoeker aan StanfordCarnegie Mellon en de Universiteit van Oxford voerden confessionele berichten van Reddit-pagina’s in een chatbot om te zien hoe de technologie het vermeende gedrag van de maker van het bericht zou beoordelen. Ze hebben het gevonden 42% van de tijd gaf de AI het ‘verkeerde’ antwoord en zei dat de persoon achter de post zich niet slecht gedroeg, ook al waren de mensen die de post beoordeelden het daar niet mee eens, schreef Notopoulos.

AI-bedrijven zijn openhartig geweest in hun pogingen om de scheeftrekkingen in hun modellen te verminderen. Eerder dit jaar, OpenAI verwijderd een update voor ChatGPT die ervoor zou zorgen dat bots reacties gaven die “overdreven ondersteunend maar niet eerlijk” waren.