Het geheugen van agenten blijft een probleem dat het bedrijf wil oplossen, omdat agenten na verloop van tijd sommige instructies of gesprekken vergeten.

Antropisch zeker dat ze dit probleem voor hem hebben opgelost Agent Claude SDKhet ontwikkelen van meerdere oplossingen waarmee agenten in verschillende contextvensters kunnen werken.

“De kernuitdaging van langlopende agenten is dat ze in afzonderlijke sessies moeten werken, en elke nieuwe sessie begint zonder herinnering aan wat er eerder is gebeurd”, schreef Anthropic in een blogpost. “Omdat contextvensters beperkt zijn en omdat de meeste complexe projecten niet in één venster kunnen worden voltooid, hebben agenten een manier nodig om de kloof tussen codeersessies te overbruggen.”

Anthropic-ingenieurs stelden een tweevoudige aanpak voor voor de Agent SDK: een initialisatieagent om de omgeving op te zetten, en een codeeragent om in elke sessie stapsgewijze vooruitgang te boeken en artefacten achter te laten voor de volgende sessie.

Geheugenproblemen met agenten

Omdat agenten op een basismodel zijn gebouwd, blijven ze beperkt door een beperkt contextvenster, hoewel ze blijven evolueren. Voor langlopende agenten kan dit grotere problemen veroorzaken, waardoor de agent instructies vergeet en zich abnormaal gedraagt tijdens het uitvoeren van taken. Verbeter het geheugen van agenten essentieel wordt voor consistente en veilige prestaties van het bedrijf.

Het afgelopen jaar zijn er verschillende methoden op de markt gekomen, die allemaal proberen de kloof tussen het contextvenster en het geheugen van de agent te overbruggen. LangChainLangMem SDK, schroot basis En Open AISwarm’s is een voorbeeld van een bedrijf dat geheugenoplossingen aanbiedt. Onderzoek naar het geheugen van agenten is de laatste tijd ook geëxplodeerd, met voorstellen raamwerken zoals Memp en het Genest leerparadigma van Googlen biedt een nieuw alternatief om het geheugen te verbeteren.

Veel geheugenframeworks zijn tegenwoordig open source en kunnen idealiter worden aangepast aan een verscheidenheid aan drijvende agenten in grote taalmodellen (LLM). Anthropic Approach verbetert de Agent Claude SDK.

Hoe werkt het

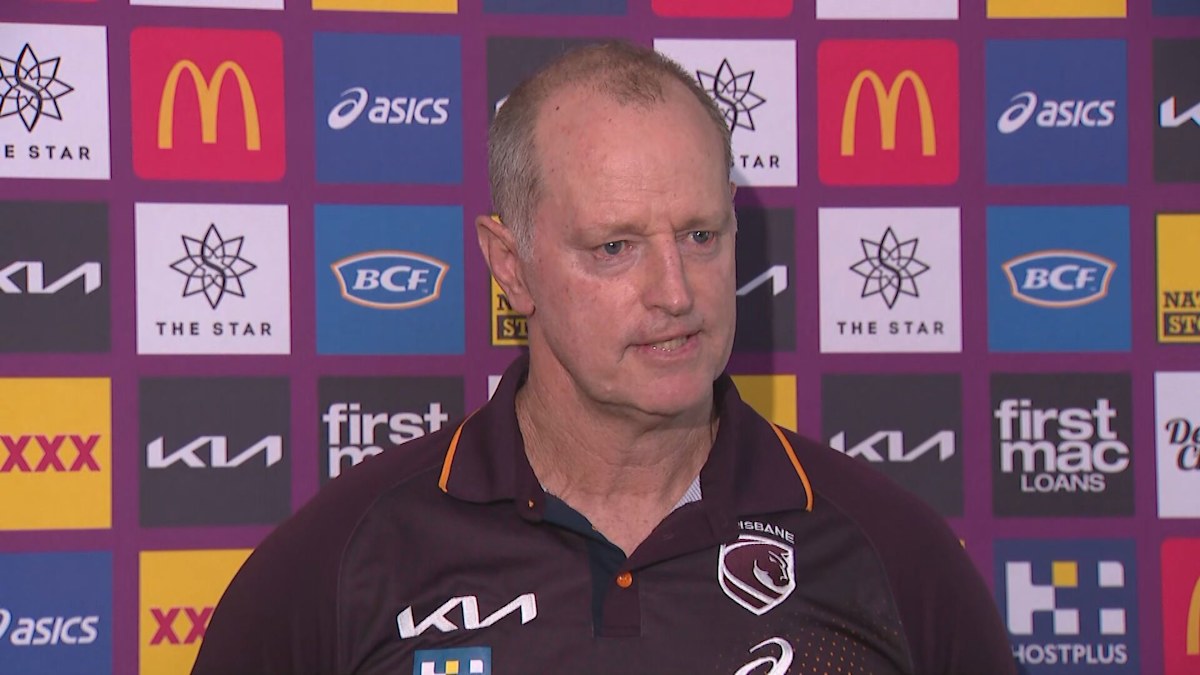

Anthropic stelde vast dat hoewel de Claude Agent SDK mogelijkheden voor contextbeheer heeft en “in staat zou moeten zijn om nuttig werk voor agenten te blijven doen voor een lange tijd”, dit niet genoeg is. Het bedrijf zegt in zijn blogpost dat het een model is zoals Opus 4.5 het uitvoeren van de Claude Agent SDK kan “er niet in slagen een webapplicatie van productiekwaliteit te bouwen als de applicatie alleen opdrachten op hoog niveau krijgt, zoals ‘maak een kloon van claude.ai.'”

De mislukkingen manifesteerden zich in twee patronen, zei Anthropic. Ten eerste probeert de agent te veel dingen te doen, waardoor het model halverwege uit zijn context raakt. De agent moet dan raden wat er is gebeurd en kan geen duidelijke instructies geven aan de volgende agent. De tweede fout vond later plaats, nadat verschillende functies waren gebouwd. De agent ziet dat er vooruitgang is geboekt en verklaart eenvoudigweg dat het werk voltooid is.

Antropische onderzoekers schetsen de oplossing: zet een initiële omgeving op om de basis te leggen voor functies en moedig elke agent aan om stapsgewijs vooruitgang te boeken in de richting van een doel, terwijl hij aan het einde nog steeds een schone lei achterlaat.

Dit is waar de tweedelige oplossing van bureau Anthropic in het spel komt. De initialisatieagent bereidt de omgeving voor en registreert wat de agent heeft gedaan en welke bestanden zijn toegevoegd. De codeeragent zal het model vervolgens vragen om stapsgewijze vooruitgang te boeken en gestructureerde updates achterwege te laten.

“De inspiratie voor deze praktijk kwam voort uit de wetenschap wat effectieve software-ingenieurs elke dag doen”, aldus Anthropic.

De onderzoekers zeggen dat ze testtools aan de codeeragent hebben toegevoegd, waardoor het beter in staat is bugs te identificeren en op te lossen die niet duidelijk uit de code alleen blijken.

Toekomstig onderzoek

Anthropic merkt op dat zijn aanpak “een mogelijke oplossing is voor het gebruik van agenten op de lange termijn.” Dit is echter nog maar het beginstadium van wat voor velen op AI-gebied een breder onderzoeksveld zou kunnen worden.

Het bedrijf zegt dat zijn experimenten om het langetermijngeheugen van agenten te verbeteren niet hebben aangetoond of een enkele codeeragent voor algemene doeleinden het beste werkt in contexten of structuren met meerdere agenten.

De demo richt zich ook op het ontwikkelen van een full-stack webapplicatie, dus andere experimenten zouden zich moeten concentreren op het generaliseren van de resultaten over verschillende taken.

“Het is waarschijnlijk dat een deel of al deze kennis kan worden toegepast op de soorten langetermijntaken die nodig zijn, bijvoorbeeld wetenschappelijk onderzoek of financiële modellen”, aldus Anthropic.